北京时间2026年4月10日

开篇:为什么你需要了解ai语音助手外壳?

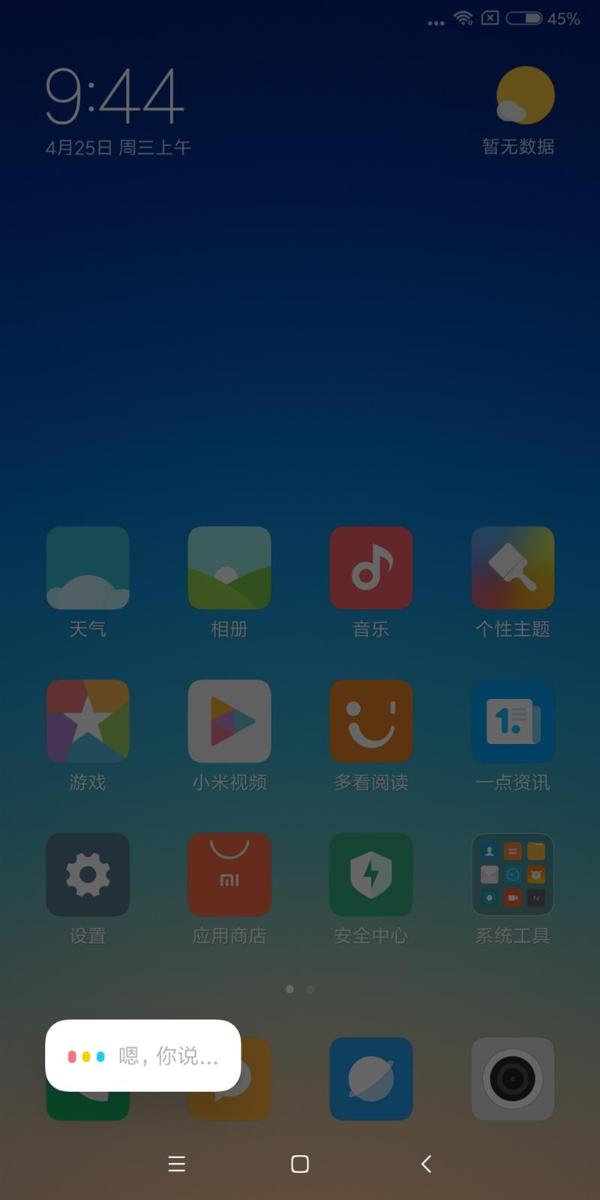

打开手机喊一声“嘿 Siri”,或者对着智能音箱说一句“小爱同学”——语音助手已经成为我们日常生活中不可或缺的交互入口。2025年,全球人工智能语音助手收入规模约467.3亿美元,预计到2032年将增长至1169.2亿美元,年复合增长率高达14.1%-。智能语音助手市场正在以惊人的速度扩张,越来越多的开发者希望亲手搭建属于自己的语音交互系统。

但很多人遇到了一个共同痛点:“我会用语音助手,但完全不知道它是怎么工作的。” 面试官问“语音助手的核心流程是什么?”——答不出。问“ASR、LLM、TTS之间如何协作?”——更懵。概念混淆、原理不清、代码不会写,是大多数技术学习者面对语音AI时的真实困境。

本文将从零开始,帮你彻底搞懂ai语音助手外壳的设计与实现。我们会先拆解核心概念,再用代码示例带你亲手搭建一个最小可用的语音助手,最后提炼面试高频考点。无论你是学生、面试备考者,还是想拓展技术栈的开发工程师,本文都能帮你建立起从概念到落地的完整知识链路。

📌 本文定位:技术科普 + 原理讲解 + 代码示例 + 面试要点

📌 技术栈:Web Speech API(前端语音识别)+ DeepSeek/OpenAI(大模型对话)+ Web Speech Synthesis API(语音合成)

一、痛点切入:为什么不能“调个API就完事”?

很多初学者构建语音助手时,会直接调用某个大模型的语音API接口。这种做法虽然能在几分钟内跑通demo,但存在几个致命问题:

// 传统“快捷方式”实现 async function quickVoiceAssistant(userSpeech) { // 直接调用云端大模型,跳过ASR和TTS的分层设计 const response = await fetch('https://api.some-llm.com/chat', { method: 'POST', body: JSON.stringify({ input: userSpeech }) }); return response.json(); // 返回的是文本,不是语音回复 }

这段代码的痛点一目了然:

① 耦合度高——语音识别、对话生成、语音合成全部揉在一起,想换一个ASR引擎就要改半套系统;

② 扩展性差——想增加方言识别功能?想加入声纹验证?只能在原有代码上“打补丁”;

③ 维护困难——出现问题很难定位是ASR识别不准、LLM理解有误还是TTS合成卡顿;

④ 无法理解原理——调通API不等于学会语音助手架构,面试官一问底层原理就露馅。

更关键的是:用户与语音助手交互时,实际上经历了“语音→文本→理解→生成→语音”的完整闭环。如果我们不拆解这个流程,就无法针对每个环节做优化——比如ASR延迟高怎么办?LLM“胡言乱语”怎么解决?TTS听起来太机械怎么改善?

这些问题,只有真正理解ai语音助手外壳的每一层架构,才能逐一攻克。

二、核心概念拆解:ASR、NLU、LLM、TTS

在开始搭建之前,先搞清楚四个核心概念。它们是构成任何ai语音助手的“四块积木”。

ASR(Automatic Speech Recognition)——自动语音识别

定义:Automatic Speech Recognition(自动语音识别),将人类语音信号转换为计算机可读文本的技术。

通俗理解:ASR就是语音助手的“耳朵”。你说“今天天气怎么样”,ASR把它转成文字“今天天气怎么样”,让机器“看懂”你在说什么。

技术演进:传统ASR采用HMM(隐马尔可夫模型)+ DNN(深度神经网络)的分离架构,需要分别训练声学模型和语言模型-15。而现在主流的端到端模型(如OpenAI的Whisper)可以直接输出文本结果,省去了中间环节,准确率和速度都有质的提升-14。

价值:ASR是语音交互的“第一道门槛”。识别不准,后面所有环节都白搭。

NLU(Natural Language Understanding)——自然语言理解

定义:Natural Language Understanding(自然语言理解),NLP的子领域,专注于让机器“理解”人类语言的语义、意图和上下文。

通俗理解:NLU是语音助手的“大脑前额叶”。用户说“我想听周杰伦的歌”,NLU要判断:意图=播放音乐,实体=周杰伦。

与LLM的关系:在传统架构中,NLU是独立模块;但在大模型时代,大语言模型(LLM)已经内置了强大的语义理解能力,可以直接替代传统的NLU组件。

LLM(Large Language Model)——大语言模型

定义:Large Language Model(大语言模型),基于海量文本数据预训练的大规模神经网络模型,具备理解和生成自然语言的能力。

通俗理解:LLM是语音助手的“大脑主体”。它接收ASR转出来的文本,结合对话历史和上下文,生成最合适的回复。

主流选择:GPT-4o、DeepSeek、Claude、文心一言等-15。

TTS(Text-to-Speech)——语音合成

定义:Text-to-Speech(语音合成),将文本转换为可听的语音输出。

通俗理解:TTS是语音助手的“嘴巴”。LLM生成了文本回复“今天天气晴朗”,TTS把它读出来,你才能“听到”答案。

技术趋势:从早期的拼接合成到WaveNet、Tacotron,再到现在的VITS和情感化TTS,合成语音已经越来越接近真人,甚至能模仿特定人的声音和情绪-15。

四者的关系图

[用户语音] → ASR(耳朵)→ [文本] → LLM(大脑)→ [回复文本] → TTS(嘴巴)→ [语音输出] ↑ ↑ (语音转文本) (NLU理解+生成)

一句话总结:ASR负责“听”,LLM负责“想”,TTS负责“说”。

三、ai语音助手外壳——模块化架构的“骨架”

上面四块积木都有了,怎么把它们拼起来?这就引出了本文的核心概念:ai语音助手外壳。

什么是“ai语音助手外壳”?

定义:ai语音助手外壳是一个模块化架构框架,将ASR、LLM、TTS等核心组件抽象为可插拔的独立模块,并提供统一的交互接口和流程编排能力。

通俗理解:如果把语音助手比作一辆汽车,AI语音助手外壳就是车身骨架 + 方向盘 + 油门刹车。骨架把发动机(LLM)、轮胎(ASR)、音响(TTS)固定在一起,方向盘和踏板则定义了驾驶员(用户)如何与汽车交互。

与“骨架”相对的是“内脏”——ASR引擎、LLM模型、TTS引擎都可以随时更换,只要接口兼容即可。

为什么需要“外壳”?

没有外壳的语音助手就像一堆散装的零件:ASR是一个独立服务、LLM是另一个API、TTS又是第三方SDK。每个组件各自为政,没有一个统一的调度者。

外壳的价值:

解耦:换ASR引擎只需改一行配置,不影响LLM和TTS

可扩展:增加新功能(如声纹识别、多语言支持)只需插入新模块

可测试:每个模块可以单独测试和优化

标准化:统一的接口定义,便于团队协作和生态建设

开源案例:OpenVoiceUI

如果你觉得“从零造轮子”太费劲,可以直接使用开源方案。OpenVoiceUI就是一个典型的ai语音助手外壳——它是一个开源的语音UI框架,不绑定任何特定的LLM、TTS引擎或STT提供商,每一层都是可插拔的插槽-21。

// OpenVoiceUI的理念示例——插件化配置 const config = { llm: { provider: 'deepseek', model: 'chat' }, // LLM可插拔 tts: { provider: 'elevenlabs', voice: 'en-US' }, // TTS可插拔 stt: { provider: 'whisper', language: 'zh-CN' } // ASR可插拔 };

你只需要提供“大脑”(LLM + TTS),它帮你处理语音输入、动画展示、画布渲染等所有外围功能-21。这种设计思路正是ai语音助手外壳的精髓。

四、概念关系总结

| 概念 | 角色定位 | 核心职责 | 与外壳的关系 |

|---|---|---|---|

| ASR | “耳朵” | 语音→文本 | 被外壳调用的组件 |

| LLM | “大脑” | 理解+生成回复 | 被外壳调用的组件 |

| TTS | “嘴巴” | 文本→语音 | 被外壳调用的组件 |

| ai语音助手外壳 | 骨架+调度器 | 组件编排+交互管理 | 整合以上所有组件 |

一句话记忆:外壳是架构,ASR/LLM/TTS是组件;外壳定义“怎么工作”,组件定义“做什么”。

五、动手实战:从0搭建一个最小ai语音助手

理论讲完了,现在用30行代码搭建一个完整的语音助手。我们将使用以下技术栈:

ASR:浏览器原生Web Speech API(语音→文本)

LLM:DeepSeek API(对话生成)

TTS:浏览器原生Web Speech Synthesis API(文本→语音)

5.1 完整代码

<!DOCTYPE html> <html> <head> <title>AI语音助手外壳实战</title> <style> body { font-family: Arial, sans-serif; max-width: 800px; margin: 0 auto; padding: 20px; } button { background: 007bff; color: white; border: none; padding: 12px 24px; border-radius: 8px; font-size: 16px; cursor: pointer; } button:disabled { background: ccc; cursor: not-allowed; } status { margin: 20px 0; padding: 10px; background: f0f0f0; border-radius: 8px; } conversation { margin-top: 20px; border-top: 1px solid ddd; padding-top: 20px; } .user { color: 007bff; margin: 10px 0; } .assistant { color: 28a745; margin: 10px 0; } </style> </head> <body> <h1>🤖 AI语音助手外壳实战</h1> <button id="startBtn" onclick="startVoiceAssistant()">🎤 点击说话</button> <button id="stopBtn" onclick="stopListening()" disabled>⏹️ 停止识别</button> <div id="status">⚡ 就绪,点击上方按钮开始语音对话</div> <div id="conversation"></div> <script> // ==================== 配置区(ai语音助手外壳的“配置层”) ==================== // 可轻松更换LLM提供商、ASR引擎、TTS引擎——这正是外壳的模块化设计精髓 const DEEPSEEK_API_KEY = 'YOUR_DEEPSEEK_API_KEY'; // 替换为你的API Key const DEEPSEEK_API_URL = 'https://api.deepseek.com/v1/chat/completions'; // 对话历史管理——让LLM具备“记忆” let conversationHistory = [ { role: 'system', content: '你是一个友好的AI语音助手,请用简洁、自然的方式回答问题。' } ]; // ASR配置(Web Speech API) let recognition = null; let isListening = false; // TTS配置(Web Speech Synthesis API) const synth = window.speechSynthesis; // UI元素引用 const startBtn = document.getElementById('startBtn'); const stopBtn = document.getElementById('stopBtn'); const statusDiv = document.getElementById('status'); const conversationDiv = document.getElementById('conversation'); // ==================== 模块1:ASR(语音→文本) ==================== function initASR() { // 兼容不同浏览器的SpeechRecognition实现[reference:7] const SpeechRecognition = window.SpeechRecognition || window.webkitSpeechRecognition; if (!SpeechRecognition) { statusDiv.innerHTML = '❌ 您的浏览器不支持语音识别,请使用Chrome/Edge浏览器'; startBtn.disabled = true; return null; } const recog = new SpeechRecognition(); recog.continuous = false; // 单次识别模式(说完自动停止) recog.interimResults = true; // 实时返回中间结果[reference:8] recog.lang = 'zh-CN'; // 中文识别 recog.maxAlternatives = 1; // 监听识别结果 recog.onresult = async (event) => { const transcript = event.results[0][0].transcript; console.log('🎤 ASR识别结果:', transcript); statusDiv.innerHTML = `🎤 识别到: "${transcript}",正在调用LLM...`; // 调用LLM生成回复(模块2) const reply = await callLLM(transcript); // 调用TTS播放回复(模块3) await speakText(reply); }; recog.onerror = (event) => { console.error('ASR错误:', event.error); statusDiv.innerHTML = `❌ 识别错误: ${event.error},请重试`; stopListening(); }; recog.onend = () => { stopListening(); }; return recog; } // ==================== 模块2:LLM(文本→回复文本) ==================== async function callLLM(userInput) { // 将用户输入加入对话历史 conversationHistory.push({ role: 'user', content: userInput }); // 显示用户消息到界面 addMessageToUI('user', userInput); try { const response = await fetch(DEEPSEEK_API_URL, { method: 'POST', headers: { 'Content-Type': 'application/json', 'Authorization': `Bearer ${DEEPSEEK_API_KEY}` }, body: JSON.stringify({ model: 'deepseek-chat', messages: conversationHistory, temperature: 0.7, max_tokens: 512, stream: false }) }); if (!response.ok) { throw new Error(`API请求失败: ${response.status}`); } const data = await response.json(); const assistantReply = data.choices[0].message.content; // 将AI回复加入对话历史 conversationHistory.push({ role: 'assistant', content: assistantReply }); // 显示AI消息到界面 addMessageToUI('assistant', assistantReply); return assistantReply; } catch (error) { console.error('LLM调用失败:', error); const errorMsg = '抱歉,我暂时无法回答,请稍后再试。'; addMessageToUI('assistant', errorMsg); return errorMsg; } } // ==================== 模块3:TTS(文本→语音) ==================== async function speakText(text) { return new Promise((resolve, reject) => { // 取消当前正在播放的语音 synth.cancel(); const utterance = new SpeechSynthesisUtterance(text); utterance.lang = 'zh-CN'; utterance.rate = 1.0; // 语速(0.5-2.0) utterance.pitch = 1.0; // 音调 utterance.onstart = () => { statusDiv.innerHTML = `🔊 正在说话: "${text.substring(0, 30)}..."`; }; utterance.onend = () => { statusDiv.innerHTML = '✅ 回复播放完毕,可以继续对话'; resolve(); }; utterance.onerror = (event) => { console.error('TTS错误:', event); statusDiv.innerHTML = '⚠️ 语音合成失败,但文本已显示在下方'; reject(event); }; synth.speak(utterance); }); } // ==================== UI辅助函数 ==================== function addMessageToUI(role, content) { const messageDiv = document.createElement('div'); messageDiv.className = role; messageDiv.innerHTML = `<strong>${role === 'user' ? '👤 你' : '🤖 AI助手'}:</strong> ${content}`; conversationDiv.appendChild(messageDiv); // 自动滚动到底部 conversationDiv.scrollTop = conversationDiv.scrollHeight; } function startVoiceAssistant() { if (isListening) return; if (!recognition) { recognition = initASR(); if (!recognition) return; } try { recognition.start(); isListening = true; startBtn.disabled = true; stopBtn.disabled = false; statusDiv.innerHTML = '🎙️ 正在监听,请说话...(说完自动识别)'; } catch (error) { console.error('启动识别失败:', error); statusDiv.innerHTML = '❌ 启动失败,请刷新页面重试'; } } function stopListening() { if (recognition && isListening) { try { recognition.stop(); } catch (e) { // 忽略stop时的错误 } } isListening = false; startBtn.disabled = false; stopBtn.disabled = true; if (statusDiv.innerHTML.includes('正在监听')) { statusDiv.innerHTML = '⏸️ 已停止识别,点击按钮继续对话'; } } // 页面加载时初始化ASR window.onload = () => { recognition = initASR(); }; // 清理TTS window.onbeforeunload = () => { synth.cancel(); }; </script> </body> </html>

5.2 代码执行流程解读

用户点击“点击说话” →

startVoiceAssistant()被调用,ASR模块开始监听麦克风用户说出“今天天气怎么样” →

recognition.onresult触发,ASR将语音转成文本LLM模块处理 →

callLLM()将文本发送给DeepSeek API,大模型结合对话历史生成回复TTS模块输出 →

speakText()将回复文本合成为语音播放出来

整个流程中,ai语音助手外壳扮演了调度器的角色:它初始化三个模块,协调它们的调用顺序,管理对话状态(conversationHistory),并处理各种异常情况。

5.3 新旧实现方式对比

| 对比维度 | ❌ 传统“调API”方式 | ✅ 本文外壳架构 |

|---|---|---|

| 代码结构 | 所有逻辑揉在一个函数里 | ASR/LLM/TTS模块清晰分离 |

| 更换ASR引擎 | 需要重写大量代码 | 只需修改initASR()中的API |

| 更换LLM模型 | 需要改多处调用 | 只需修改callLLM()中的endpoint |

| 对话历史管理 | 通常被忽略 | 内置在LLM模块中,支持多轮对话 |

| 可测试性 | 几乎无法单独测试 | 每个模块可独立测试 |

| 面试加分 | ❌ 暴露知识盲区 | ✅ 展现架构思维 |

六、底层技术支撑——外壳背后的“地基”

理解ai语音助手外壳,必须了解它依赖的底层技术:

1. Web Speech API

在浏览器端,ASR和TTS功能的实现依赖于Web Speech API。它包含两个核心接口:SpeechRecognition(语音识别)和SpeechSynthesis(语音合成)-39。

实现机制:Web Speech API并非完全在本地处理,在某些浏览器(如Chrome)中,音频数据会被发送到云端识别引擎进行处理-。这意味着:

优点:无需自己部署ASR模型,开箱即用

缺点:依赖网络,无离线能力,识别精度受限于服务端

2. HTTP/WebSocket通信

LLM模块通过HTTP API调用云端大模型。如果想实现更低延迟的实时对话(如边想边说、打断恢复),需要升级到WebSocket长连接和流式传输。

3. 事件驱动架构

整个外壳基于事件驱动:onresult(ASR完成)触发LLM调用,LLM回调触发TTS播放。这种架构天然支持异步解耦,也便于后续加入中间件(如敏感词过滤、日志记录)。

4. 状态管理

conversationHistory数组维护了多轮对话上下文,让LLM具备“记忆”。这是实现连贯对话的核心机制。

七、高频面试题(含参考答案)

面试题1:请简述AI语音助手的完整技术流程。

参考答案:

AI语音助手通常采用级联架构,包含三个核心环节:

ASR(自动语音识别) :将用户语音输入转换为文本,主流方案包括Whisper、Deepgram等。端到端模型正逐步取代传统的HMM+DNN架构。

LLM(大语言模型)处理:将ASR输出的文本送入LLM(如GPT-4、DeepSeek),结合对话历史和系统提示词生成回复文本。关键优化包括RAG(检索增强生成)防止“幻觉”,以及流式输出降低首字延迟。

TTS(语音合成) :将LLM生成的文本合成为自然语音输出。现代TTS已支持情感化合成和实时流式输出。

三者通过语音助手外壳(模块化编排框架)串联,统一的调度器负责组件间的数据流转、状态管理和异常处理-。

面试题2:AI语音助手响应太慢,你会怎么优化?

参考答案:

从三个层面入手:

① 流式分句合成(边想边说) :不等LLM生成完整个回复,只要生成前20-30个字(一个完整句子),就立即送入TTS开始播放。这样用户听第一句时,AI还在后台生成第二句,体感延迟可从2秒降至300ms以内-29。

② 流式ASR:使用支持流式输出的ASR模型(如Deepgram Nova-3,首字延迟约150ms),在用户说话过程中就开始转录,而不是等用户说完再处理-52。

③ 量化与缓存:对LLM进行4bit量化,内存占用可降低约75%;使用Redis缓存常见问题的回复,命中时可直接跳过LLM推理。

面试题3:如何防止AI在专业场景下“胡言乱语”(幻觉)?

参考答案:

采用 RAG(检索增强生成) 策略:

建立向量数据库:将企业的知识文档(如产品手册、FAQ、保修条款)向量化后存入Milvus/Pinecone;

先检索再生成:用户提问时,先在向量库中检索最相关的Top-K段落;

限定回答范围:将检索到的段落作为上下文注入LLM的提示词中,要求“请只根据以下内容回答,不知道就说转人工”-29。

实践证明,这种方式可将专业场景下的准确率从约70%提升到91%以上。

面试题4:ASR、NLU、LLM、TTS四者的关系是什么?

参考答案:

ASR(自动语音识别)负责语音→文本

NLU(自然语言理解)负责理解语义,但在大模型时代,这一功能已被LLM内置

LLM(大语言模型)负责理解+生成,是语音助手的“大脑”

TTS(文本转语音)负责文本→语音

四者的数据流为:语音输入 → ASR → 文本 → LLM(含NLU能力)→ 回复文本 → TTS → 语音输出-49。

面试题5:用户说话中途打断AI播放,技术上是如何实现的?

参考答案:

需要实现双工打断监测机制:

前端监测:持续监测麦克风音频能量,一旦检测到用户有新的语音输入,立即通过WebSocket发送STOP信号给后端;

后端熔断:接收到STOP信号后,立刻终止LLM的token生成流,并取消正在进行的TTS合成;

资源回收:立即释放相关计算资源,避免浪费API调用费用-29。

核心要点:打断不仅要“掐断声音”,更要“掐断token”,否则会产生不必要的成本消耗。

八、结尾总结

回顾全文,我们梳理了以下核心知识点:

| 知识点 | 关键内容 |

|---|---|

| 四组件 | ASR(听)→ LLM(想)→ TTS(说),NLU被LLM内置 |

| 外壳概念 | 模块化编排框架,解耦组件、统一调度、可插拔设计 |

| 代码实现 | Web Speech API(ASR/TTS)+ DeepSeek API(LLM) |

| 优化策略 | 流式分句合成、RAG防幻觉、量化压缩、双工打断 |

| 面试考点 | 完整流程、延迟优化、幻觉处理、打断机制 |

易错点提醒:

❌ 不要把ASR和TTS混淆——前者是“听”,后者是“说”

❌ 不要跳过对话历史管理——缺少上下文会导致AI“失忆”

❌ 不要忽视浏览器兼容性——Web Speech API在Firefox/Safari上支持不完整

📌 下一步学习建议:

如果你想继续深入,可以关注以下方向:

本地化部署:使用Whisper.cpp + Ollama + VITS,实现完全离线的语音助手

多模态融合:结合摄像头实现唇动识别和情绪感知

端到端统一模型:如GPT-4o,将ASR/LLM/TTS融合到单一模型中-15

下一篇我们将深入讲解 “如何用RAG构建企业级智能语音客服” ,敬请期待!

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司